La discusión sobre inteligencia artificial en la educación superior suele plantearse como un debate de futuro. Sin embargo, los datos muestran que ese futuro ya ocurrió. Hoy, la IA está plenamente integrada en la vida académica del estudiantado, mientras que la respuesta institucional sigue siendo parcial, reactiva y fragmentada.

Un estudio reciente sobre el INTELIGENCIA ARTIFICIAL Y UNIVERSIDAD: USO Y PERCEPCIÓN DE LA IA EN EL ENTORNO UNIVERSITARIO, publicado por la Fundación CYD (Fundación Conocimiento y Desarrollo) promotora de la contribución que las universidades españolas ejercen sobre el desarrollo económico y social del país. El estudio está basado en encuestas realizadas entre abril–junio de 2024 a universidades y en febrero de 2025 a estudiantes, confirma una realidad que exige decisiones urgentes ⏳.

📊 Una adopción estudiantil masiva… sin marco común

El dato es contundente:

- 89% de los estudiantes universitarios de grado utiliza herramientas de inteligencia artificial.

- 35% las usa a diario

- 44% varias veces por semana

👉 9 de cada 10 estudiantes usan IA de forma frecuente o intensiva.

Los usos principales no son marginales ni anecdóticos:

- 🧠 66% para resolver dudas o problemas académicos

- 📚 48% para investigación y análisis de información

- ✍️ 45% para redacción o corrección de trabajos

La conclusión es clara: la IA ya es una herramienta estructural del aprendizaje, no un experimento ni una moda.

🧑🎓🚫 ¿Y quiénes no usan inteligencia artificial?

Aunque la adopción de la inteligencia artificial es mayoritaria, el estudio también identifica a un 11% de estudiantes universitarios que no utiliza herramientas de IA. Las razones son reveladoras: 52% considera que su uso es poco ético en el ámbito académico, mientras que 35% prefiere evitarlo por preocupaciones relacionadas con la seguridad y la privacidad de sus datos.

Este grupo minoritario no representa resistencia al cambio tecnológico, sino una señal de alerta institucional. Su postura refleja la ausencia de lineamientos claros, marcos éticos compartidos y formación oficial que permita a los estudiantes comprender cuándo, cómo y bajo qué condiciones es legítimo y seguro usar la IA en el entorno universitario.

Paradójicamente, estos estudiantes no están protegidos por no usar IA: están excluidos de una competencia digital que el propio sistema reconoce como esencial para el futuro laboral, lo que refuerza la urgencia de una gobernanza de la inteligencia digital que no normalice el uso acrítico, pero tampoco castigue la cautela informada.

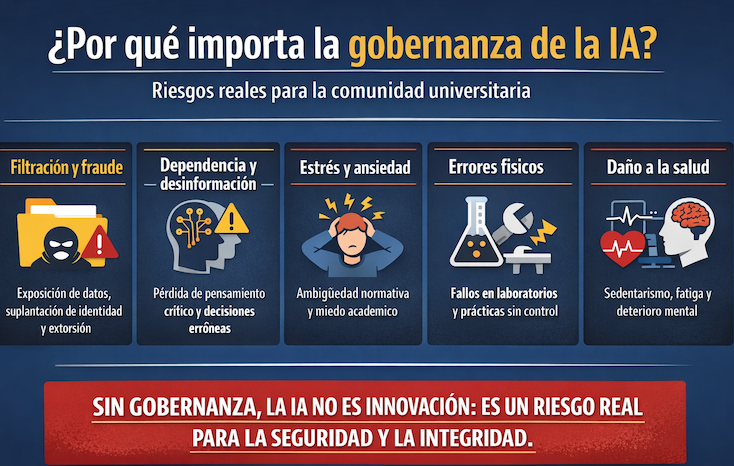

Riesgos inmediatos (los que ya están ocurriendo) ⚠️

Usar inteligencia artificial sin gobernanza, sin control y sin responsabilidad institucional es una forma de negligencia.

No es innovación, es abandono. En la práctica, significa exponer a estudiantes y docentes a la pérdida y explotación de datos personales, a fraudes, suplantación de identidad, extorsión y acoso; normalizar la dependencia cognitiva y la renuncia al pensamiento crítico; y operar en un entorno de ambigüedad que genera miedo, estrés y autocensura.

En disciplinas técnicas, científicas y de la salud, el uso no regulado de IA puede provocar errores graves con consecuencias físicas reales en laboratorios, prácticas profesionales y trabajo de campo. A esto se suman daños acumulativos a la salud (sedentarismo, fatiga visual, deterioro de la salud mental) y una mayor vulnerabilidad frente a ciberataques cada vez más agresivos.

📈 Rendimiento académico y riesgos: dos realidades simultáneas

El 63% de los estudiantes considera que la IA mejora significativamente su rendimiento académico. Solo un 4% cree que no aporta valor. Pero esta adopción no es ingenua:

- 🔐 79% está preocupado por la seguridad y privacidad de los datos

- 33% muy preocupado

- 46% algo preocupado

- ⚖️ Casi la mitad expresa inquietudes éticas sobre su uso académico

📌 El mensaje es contundente: los estudiantes sí reconocen los riesgos, pero no están recibiendo el acompañamiento institucional necesario para gestionarlos.

Los resultados muestran que:

- ✔️ Prácticamente todas usan IA en docencia e investigación

- 📄 Principalmente para generación de contenidos y apoyo académico

- ⚠️ Uso muy limitado en:

- tutorías personalizadas

- evaluación del aprendizaje

- acompañamiento individual al estudiante

Al mismo tiempo:

- 🚨 La gran mayoría ha detectado uso de IA en exámenes

- ❌ Menos de la mitad ha modificado sus modelos de evaluación

- Predominan preocupaciones por:

- plagio

- dificultad de detección

- aprendizajes superficiales

- reducción del esfuerzo académico

Paradójicamente, casi todas coinciden en que se está desaprovechando el potencial de la IA.

🚨 Un llamado urgente a la acción

El verdadero desafío es otro: ¿Cómo gobernar la inteligencia digital en la universidad?

Hablar de IA sin integrar:

- 🧠 inteligencia digital

- 🔐 ciberseguridad

- 📜 protección de datos

- ⚖️ ética

- 🏗️ capacidades institucionales

La universidad, como institución estratégica para el desarrollo social y económico, no puede seguir reaccionando tarde.

Se requiere con urgencia:

- 🏛️ una política de gobernanza de la inteligencia digital,

- 🤖 integración real de la IA en docencia y evaluación,

- 🔐 formación obligatoria en ciberseguridad y uso responsable,

- 🧩 una visión institucional que entienda que tecnología, educación y seguridad ya son inseparables.

📌 Cuando no hay gobernanza, la IA deja de ser una herramienta educativa y se convierte en un riesgo directo para la seguridad, la salud y la integridad física y emocional de las personas. Ignorar esto no es neutralidad: es irresponsabilidad institucional. Porque la inteligencia artificial ya está en el aula. Lo que falta es la decisión de gobernarla.

La pregunta final: ¿En tu universidad, ya tienen normado el uso de la tecnología, el uso ético de la inteligencia artificial y la gestión de riesgos cibernéticos?

Saludos cordiales

Daniel Santin.

Si requieres más información al respecto, escríbenos (whatsapp) o agenda una cita en línea.

P.D. Como complemento les recomiendo mucho esta platica de Charla de Geoffrey Hinton y Bernie Sanders sobre promesas y peligros de la IA en la Universidad de Georgetown.